p>A Inteligência artificial assusta-nos e intriga-nos. Quase todas as semanas, há um novo susto de IA nas notícias, como os criadores que fecham os “bots” porque se tornaram demasiado inteligentes. A maioria destas notícias são o resultado de uma investigação sobre IA mal interpretada por aqueles que estão fora do campo. Para os fundamentos da IA, sinta-se à vontade para ler o nosso abrangente artigo sobre IA.

O maior medo sobre a IA é a singularidade (também chamada Inteligência Geral Artificial), um sistema capaz de pensar a nível humano. De acordo com alguns especialistas, a singularidade também implica a consciência da máquina. Independentemente de ser consciente ou não, tal máquina poderia melhorar continuamente a si própria e ir muito além das nossas capacidades. Mesmo antes de a inteligência artificial ser um tema de investigação em informática, escritores de ficção científica como Asimov estavam preocupados com isto e estavam a conceber mecanismos (ou seja, as Leis da Robótica de Asimov) para assegurar a benevolência de máquinas inteligentes.

Para aqueles que vieram para obter respostas rápidas:

- A singularidade alguma vez irá acontecer? Segundo a maioria dos peritos em IA, sim.

- Quando é que a singularidade vai acontecer? Antes do fim do século

As respostas mais nuances estão abaixo. Houve vários inquéritos e pesquisas de cientistas sobre a IA perguntando sobre quando tais desenvolvimentos terão lugar.

Entender os resultados dos principais inquéritos dos investigadores de IA em 2 minutos

Vemos os resultados de 4 inquéritos com 995 participantes onde os investigadores estimaram quando é que a singularidade aconteceria. Em todos os casos, a maioria dos participantes esperava a singularidade da IA antes de 2060.

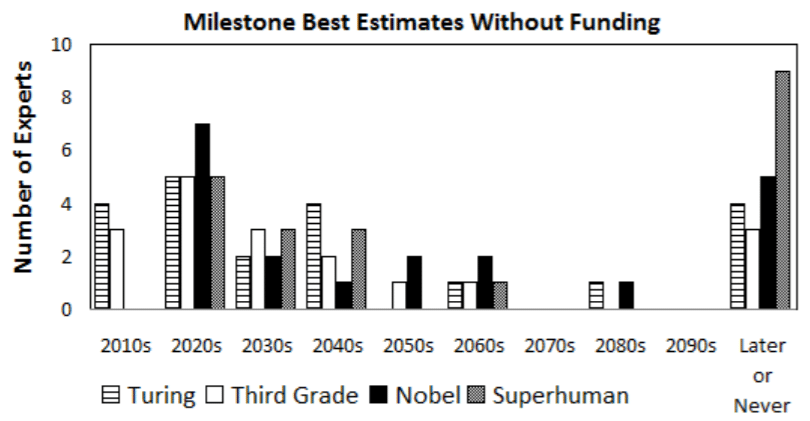

Em 2009, 21 peritos em IA que participaram na conferência AGI-09 foram inquiridos. Os peritos acreditam que a AGI irá ocorrer por volta de 2050, e plausivelmente mais cedo. Pode ver acima as suas estimativas relativamente a realizações específicas de IA: passar no teste Turing, passar no terceiro ano, realizar descobertas científicas dignas de Nobel e alcançar inteligência sobre-humana.

Em 2012/2013, Vincent C. Muller, o presidente da Associação Europeia para Sistemas Cognitivos, e Nick Bostrom da Universidade de Oxford, que publicou mais de 200 artigos sobre superinteligência e inteligência geral artificial (AGI), realizaram um inquérito aos investigadores de IA. 550 participantes responderam à pergunta: “Quando é que a AGI pode acontecer?” As respostas são distribuídas como

- 10% dos participantes pensam que o AGI é provável que aconteça até 2022

- Para 2040, a percentagem é de 50%

- 90% dos participantes pensam que o AGI é provável que aconteça até 2075.

Em 2017 de Maio, foram inquiridos 352 peritos em IA que publicaram nas conferências NIPS e ICML de 2015. Com base nos resultados do inquérito, os peritos estimam que existe uma probabilidade de 50% de que a AGI ocorra até 2060. No entanto, existe uma diferença significativa de opinião com base na geografia: Os asiáticos inquiridos esperam que a AGI ocorra em 30 anos, enquanto os norte-americanos esperam que ocorra em 74 anos. Algumas funções significativas que se espera que sejam automatizadas até 2030 são: Representantes do call center, condução de camiões, vendas a retalho.

Em 2019, 32 peritos AI participaram num inquérito sobre o calendário AGI:

- 45% dos inquiridos prevêem uma data antes de 2060

- 34% de todos os participantes previram uma data depois de 2060

- 21% dos participantes previram que a singularidade nunca irá ocorrer.

Os empresários do MIT também estão a fazer estimativas sobre quando chegaremos à singularidade e são um pouco mais optimistas do que os investigadores:

- Louis Rosenberg, informático, empresário e escritor: 2030

li>Patrick Winston, professor do MIT e director do Laboratório de Inteligência Artificial do MIT de 1972 a 1997: 2040 li>Ray Kuzweil, informático, empresário e escritor de 5 best sellers nacionais incluindo The Singularity Is Near : 2045 li>Jürgen Schmidhuber, co-fundador da empresa AI NNAISENSE e director do Laboratório Suíço de Inteligência Artificial IDSIA: ~2050

Cuidado que os investigadores de IA eram demasiado optimistas antes

Exemplos incluem:

- AI pioneiro Herbert A. Simon em 1965: “As máquinas serão capazes, dentro de vinte anos, de fazer qualquer trabalho que um homem possa fazer”

li> O Computador de Quinta Geração do Japão em 1980 tinha uma linha temporal de dez anos com objectivos como “levar a cabo conversas casuais”

p> Esta experiência histórica contribui para que a maioria dos cientistas actuais se afastem de prever a AGI em prazos arrojados como 10-20 anos. Contudo, só porque agora são mais conservadores, não significa que desta vez tenham razão.

Entenda porque é que chegar ao AGI parece inevitável para a maioria dos peritos

Estas podem parecer previsões selvagens, mas parecem bastante razoáveis quando se consideram estes factos:

- A inteligência humana é fixa, a menos que de alguma forma fundamos as nossas capacidades cognitivas com as máquinas. O arranque de Elon Musk em renda neural visa fazer isto, mas a investigação sobre rendas neurais está nas fases iniciais.

li>A inteligência da máquina depende de algoritmos, poder de processamento e memória. O poder de processamento e a memória têm vindo a crescer a um ritmo exponencial. Quanto aos algoritmos, até agora temos sido bons a fornecer às máquinas os algoritmos necessários para utilizar eficazmente o seu poder de processamento e memória.

considerando que a nossa inteligência é fixa e a inteligência das máquinas está a crescer, é apenas uma questão de tempo até que as máquinas nos ultrapassem, a menos que haja algum limite difícil para a sua inteligência. Ainda não encontramos tal limite.

Esta é uma boa analogia para compreender o crescimento exponencial. Embora as máquinas possam parecer estúpidas neste momento, podem crescer de forma bastante inteligente, muito em breve.

Se a computação clássica abranda o seu crescimento, a computação quântica poderia complementá-la

A computação clássica levou-nos bastante longe. Os algoritmos de IA nos computadores clássicos podem exceder o desempenho humano em tarefas específicas como jogar xadrez ou Go. Por exemplo, o AlphaGo Zero venceu o AlphaGo por 100-0. AlphaGo tinha batido os melhores jogadores da Terra. Contudo, estamos a aproximar-nos dos limites de quão rápido podem ser os computadores clássicos.

A lei de Moore, que se baseia na observação de que o número de transístores num circuito integrado denso duplica cerca de dois em dois anos, implica que o custo de computação se reduz para metade aproximadamente a cada 2 anos. Contudo, a maioria dos especialistas acredita que a lei de Moore está a chegar ao fim durante esta década. Embora haja esforços para continuar a melhorar o desempenho das aplicações, será um desafio manter as mesmas taxas de crescimento.

Quantum Computing, que ainda é uma tecnologia emergente, pode contribuir para reduzir os custos de computação depois de a lei de Moore chegar ao fim. A Quantum Computing baseia-se na avaliação de diferentes estados ao mesmo tempo, onde os computadores clássicos podem calcular um estado de cada vez. A natureza única da computação quântica pode ser utilizada para treinar eficientemente as redes neurais, actualmente a arquitectura AI mais popular em aplicações comerciais. Os algoritmos de IA executados em computadores quânticos estáveis têm uma hipótese de desbloquear a singularidade.

Para mais informações sobre computadores quânticos, sinta-se à vontade para ler os nossos artigos sobre computação quântica.

Entenda porque alguns não acreditam que nunca chegaremos ao AGI

Existem 3 argumentos principais contra a importância ou existência do AGI. Examinámo-los juntamente com as suas refutações comuns:

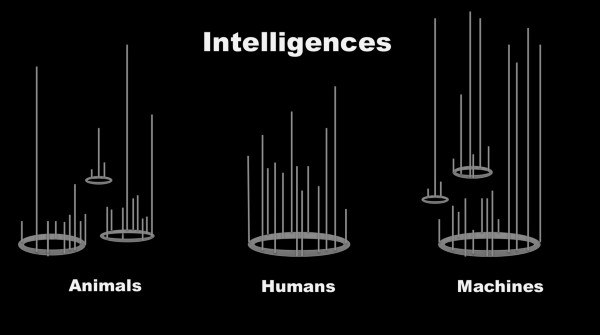

1- A inteligência é multi-dimensional

Por isso, o AGI será diferente, não superior à inteligência humana. Isto é verdade e a inteligência humana é também diferente da inteligência animal. Alguns animais são capazes de feitos mentais surpreendentes, como esquilos, lembrando onde esconderam centenas de nozes durante meses.

No entanto, estas diferenças não impedem os humanos de alcançar muito mais do que outras espécies em termos de muitas medidas típicas de sucesso para uma espécie. Por exemplo, o homo sapiens é a espécie que mais contribui para a bio-massa no globo entre os mamíferos.

2- A inteligência não é a solução para todos os problemas

Por exemplo, mesmo a melhor máquina que analisa os dados existentes provavelmente não será capaz de encontrar uma cura para o cancro. Terá de realizar experiências e analisar resultados para descobrir novos conhecimentos na maioria das áreas.

Isto é verdade com algumas advertências. Mais inteligência pode levar a experiências melhor concebidas e geridas, permitindo mais descobertas por experiência. A história da produtividade da investigação deve provavelmente demonstrar isto, mas os dados são bastante ruidosos e há rendimentos decrescentes na investigação. Encontramos problemas mais difíceis como a física quântica à medida que resolvemos problemas mais simples como o movimento Newtoniano.

3- AGI não é possível porque não é possível modelar o cérebro humano

Teoricamente é possível modelar qualquer máquina computacional, incluindo o cérebro humano, com uma máquina relativamente simples que pode efectuar cálculos básicos e tem acesso a memória e tempo infinitos. Esta é a hipótese da Igreja-Turing, apresentada em 1950. É universalmente aceite. Contudo, como foi dito, requer certas condições difíceis: tempo e memória infinitos.

Muitos cientistas informáticos acreditam que será necessário menos do que tempo e memória infinitos para modelar o cérebro humano. Contudo, não existe uma forma matematicamente sólida de provar esta crença, pois não compreendemos o cérebro o suficiente para compreender exactamente o seu poder computacional. Teremos apenas de construir uma tal máquina!

E ainda não fomos bem sucedidos. Embora o modelo de linguagem GPT-3 lançado em Junho/2020 tenha causado uma excitação significativa com a sua fluência, a sua falta de compreensão lógica torna a sua saída propensa a erros. Para um exemplo mais dramático, este é um vídeo sobre o que acontece quando as máquinas jogam futebol. É um pouco datado (de 2017) mas faz-me sentir como uma lenda do futebol em comparação:

Para aprender mais sobre Inteligência Geral Artificial

Palestra de Ray Kurzweil:

Joshua Brett Tenenbaum, Professor de Ciência Cognitiva e Computação no MIT, está a explicar como podemos alcançar a singularidade AGI:

Espera que isto clarifique alguns dos principais pontos relativos à AGI. Para mais informações sobre como a IA está a mudar o mundo, pode consultar artigos sobre IA, tecnologias de IA e aplicações de IA em marketing, vendas, serviço ao cliente, TI, dados ou análises. Ou pode seguir a nossa página Linkedin onde partilhamos como a IA está a afectar empresas e indivíduos ou a nossa conta no Twitter.

E se tiver um problema de negócio que não é abordado aqui:

Deixe-nos encontrar o fornecedor certo para o seu negócio

0 comentários