L’intelligence artificielle nous effraie et nous intrigue. Presque chaque semaine, il y a une nouvelle peur de l’IA dans l’actualité, comme des développeurs qui ferment des bots parce qu’ils sont devenus trop intelligents. La plupart de ces nouvelles sont le résultat de recherches sur l’IA mal interprétées par des personnes extérieures au domaine. Pour connaître les principes fondamentaux de l’IA, n’hésitez pas à lire notre article complet sur l’IA.

La plus grande crainte concernant l’IA est la singularité (également appelée intelligence générale artificielle), un système capable d’une pensée de niveau humain. Selon certains experts, la singularité implique également la conscience de la machine. Qu’elle soit consciente ou non, une telle machine pourrait s’améliorer en permanence et aller bien au-delà de nos capacités. Avant même que l’intelligence artificielle ne soit un sujet de recherche en informatique, des auteurs de science-fiction comme Asimov s’en préoccupaient et concevaient des mécanismes (c’est-à-dire les lois de la robotique d’Asimov) pour garantir la bienveillance des machines intelligentes.

Pour ceux qui sont venus chercher des réponses rapides :

- La singularité se produira-t-elle un jour ? Selon la plupart des experts en IA, oui.

- Quand la singularité se produira-t-elle ? Avant la fin du siècle

Les réponses plus nuancées se trouvent ci-dessous. Il y a eu plusieurs enquêtes et recherches de chercheurs en IA s’interrogeant sur le moment où de tels développements auront lieu.

Comprendre les résultats des principales enquêtes des chercheurs en IA en 2 minutes

Nous avons examiné les résultats de 4 enquêtes avec 995 participants où les chercheurs ont estimé quand la singularité se produirait. Dans tous les cas, la majorité des participants s’attendaient à une singularité de l’IA avant 2060.

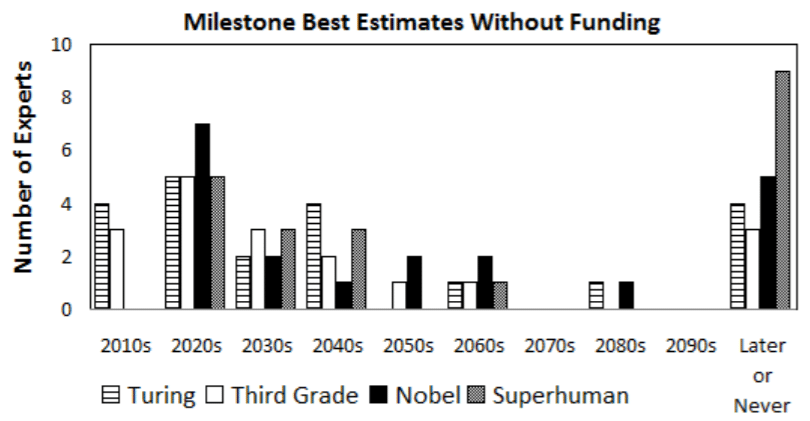

En 2009, 21 experts en IA participant à la conférence AGI-09 ont été interrogés. Les experts pensent que l’AGI se produira vers 2050, voire plus tôt de manière plausible. Vous pouvez voir ci-dessus leurs estimations concernant des réalisations spécifiques de l’IA : passer le test de Turing, passer le CE2, accomplir des percées scientifiques dignes d’un Nobel et atteindre une intelligence surhumaine.

En 2012/2013, Vincent C. Muller, le président de l’Association européenne pour les systèmes cognitifs, et Nick Bostrom de l’Université d’Oxford, qui a publié plus de 200 articles sur la superintelligence et l’intelligence générale artificielle (AGI), ont mené une enquête auprès des chercheurs en IA. 550 participants ont répondu à la question : « Quand l’AGI est-elle susceptible d’arriver ? » Les réponses sont réparties comme suit

- 10% des participants pensent que l’AGI est susceptible d’arriver d’ici 2022

- Pour 2040, la part est de 50%

- 90% des participants pensent que l’AGI est susceptible d’arriver d’ici 2075.

En mai 2017, 352 experts en IA qui ont publié lors des conférences NIPS et ICML de 2015 ont été interrogés. Sur la base des résultats du sondage, les experts estiment qu’il y a 50 % de chances que l’AGI se produise jusqu’en 2060. Cependant, il existe une différence d’opinion significative en fonction de la géographie : Les répondants asiatiques s’attendent à ce que l’AGI se produise dans 30 ans, tandis que les Nord-Américains s’attendent à ce qu’elle se produise dans 74 ans. Certaines fonctions professionnelles importantes devraient être automatisées d’ici 2030 : Les représentants de centres d’appels, la conduite de camions, la vente au détail.

En 2019, 32 experts en IA ont participé à une enquête sur le calendrier de l’AGI :

- 45 % des répondants prédisent une date avant 2060

- 34 % de tous les participants prédisent une date après 2060

- 21 % des participants prédisent que la singularité ne se produira jamais.

Les entrepreneurs de l’IA font également des estimations sur le moment où nous atteindrons la singularité et ils sont un peu plus optimistes que les chercheurs :

- Louis Rosenberg, informaticien, entrepreneur et écrivain : 2030

- Patrick Winston, professeur au MIT et directeur du laboratoire d’intelligence artificielle du MIT de 1972 à 1997 : 2040

- Ray Kuzweil, informaticien, entrepreneur et écrivain de 5 best-sellers nationaux dont The Singularity Is Near : 2045

- Jürgen Schmidhuber, cofondateur à la société d’IA NNAISENSE et directeur du laboratoire suisse d’IA IDSIA : ~2050

N’oubliez pas que les chercheurs en IA étaient trop optimistes auparavant

Les exemples incluent :

- Le pionnier de l’IA Herbert A. Simon en 1965 : « les machines seront capables, d’ici vingt ans, de faire n’importe quel travail qu’un homme peut faire. »

- L’ordinateur de cinquième génération du Japon en 1980 avait un calendrier de dix ans avec des objectifs comme « mener des conversations occasionnelles »

Cette expérience historique contribue à ce que la plupart des scientifiques actuels hésitent à prédire l’AGI dans des délais audacieux comme 10-20 ans. Cependant, ce n’est pas parce qu’ils sont plus conservateurs aujourd’hui qu’ils ont raison cette fois-ci.

Comprendre pourquoi atteindre l’AGI semble inévitable pour la plupart des experts

Ces prédictions peuvent sembler farfelues, mais elles semblent tout à fait raisonnables lorsque vous considérez ces faits :

- L’intelligence humaine est figée, à moins que nous ne fusionnions d’une manière ou d’une autre nos capacités cognitives avec des machines. La startup de dentelles neurales d’Elon Musk vise à le faire, mais la recherche sur les dentelles neurales n’en est qu’à ses débuts.

- L’intelligence des machines dépend des algorithmes, de la puissance de traitement et de la mémoire. La puissance de traitement et la mémoire ont augmenté à un rythme exponentiel. Quant aux algorithmes, jusqu’à présent, nous avons été bons pour fournir aux machines les algorithmes nécessaires pour utiliser efficacement leur puissance de traitement et leur mémoire.

Considérant que notre intelligence est fixe et que celle des machines augmente, ce n’est qu’une question de temps avant que les machines ne nous dépassent, à moins qu’il n’y ait une limite dure à leur intelligence. Nous n’avons pas encore rencontré une telle limite.

C’est une bonne analogie pour comprendre la croissance exponentielle. Alors que les machines peuvent sembler idiotes pour le moment, elles peuvent devenir très intelligentes, très bientôt.

Si l’informatique classique ralentit sa croissance, l’informatique quantique pourrait la compléter

L’informatique classique nous a menés assez loin. Les algorithmes d’IA sur les ordinateurs classiques peuvent dépasser les performances humaines dans des tâches spécifiques comme jouer aux échecs ou au Go. Par exemple, AlphaGo Zero a battu AlphaGo par 100-0. AlphaGo avait battu les meilleurs joueurs de la planète. Cependant, nous approchons des limites de la vitesse des ordinateurs classiques.

La loi de Moore, qui repose sur l’observation que t le nombre de transistors dans un circuit intégré dense double environ tous les deux ans, implique que le coût de l’informatique diminue de moitié tous les deux ans environ. Cependant, la plupart des experts estiment que la loi de Moore touche à sa fin au cours de cette décennie. Bien que des efforts soient déployés pour continuer à améliorer les performances des applications, il sera difficile de maintenir les mêmes taux de croissance.

L’informatique quantique, qui est encore une technologie émergente, peut contribuer à réduire les coûts de calcul après la fin de la loi de Moore. L’informatique quantique repose sur l’évaluation de différents états en même temps, là où les ordinateurs classiques peuvent calculer un seul état à la fois. La nature unique de l’informatique quantique peut être utilisée pour former efficacement les réseaux neuronaux, qui constituent actuellement l’architecture d’IA la plus populaire dans les applications commerciales. Les algorithmes d’IA fonctionnant sur des ordinateurs quantiques stables ont une chance de débloquer la singularité.

Pour plus d’informations sur les ordinateurs quantiques n’hésitez pas à lire nos articles sur l’informatique quantique.

Comprendre pourquoi certains ne croient pas que nous n’atteindrons jamais l’AGI

Il existe 3 arguments majeurs contre l’importance ou l’existence de l’AGI. Nous les avons examinés ainsi que leurs réfutations communes :

1- L’intelligence est multidimensionnelle

Par conséquent, l’AGI sera différente et non supérieure à l’intelligence humaine. C’est vrai et l’intelligence humaine est également différente de l’intelligence animale. Certains animaux sont capables de prouesses mentales étonnantes, comme les écureuils qui se souviennent de l’endroit où ils ont caché des centaines de noix pendant des mois.

Cependant, ces différences n’empêchent pas les humains de réaliser bien plus que les autres espèces en termes de nombreuses mesures typiques du succès d’une espèce. Par exemple, homo sapiens est l’espèce qui contribue le plus à la bio-masse sur le globe parmi les mammifères.

2- L’intelligence n’est pas la solution à tous les problèmes

Par exemple, même la meilleure machine analysant les données existantes ne sera probablement pas capable de trouver un remède contre le cancer. Elle devra mener des expériences et analyser les résultats pour découvrir de nouvelles connaissances dans la plupart des domaines.

C’est vrai avec quelques réserves. Plus d’intelligence peut conduire à des expériences mieux conçues et gérées, permettant plus de découvertes par expérience. L’histoire de la productivité de la recherche devrait probablement le démontrer, mais les données sont assez bruyantes et il y a des rendements décroissants sur la recherche. Nous rencontrons des problèmes plus difficiles comme la physique quantique à mesure que nous résolvons des problèmes plus simples comme le mouvement newtonien.

3- L’AGI n’est pas possible parce qu’il n’est pas possible de modéliser le cerveau humain

Théoriquement, il est possible de modéliser toute machine de calcul, y compris le cerveau humain, avec une machine relativement simple qui peut effectuer des calculs de base et qui a accès à une mémoire et à un temps infinis. C’est l’hypothèse de Church-Turing énoncée en 1950. Elle est universellement acceptée. Cependant comme indiqué, elle nécessite certaines conditions difficiles : un temps et une mémoire infinis.

La plupart des informaticiens pensent qu’il faudra moins qu’un temps et une mémoire infinis pour modéliser le cerveau humain. Cependant, il n’existe pas de moyen mathématiquement solide pour prouver cette croyance, car nous ne comprenons pas suffisamment le cerveau pour connaître exactement sa puissance de calcul. Nous devrons simplement construire une telle machine !

Et nous n’y sommes pas encore parvenus. Bien que le modèle de langage GPT-3 lancé en juin/2020 ait suscité un enthousiasme considérable par sa fluidité, son manque de compréhension logique rend sa sortie sujette aux erreurs. Pour un exemple plus dramatique, voici une vidéo de ce qui se passe lorsque des machines jouent au football. Elle date un peu (de 2017) mais fait que même moi je me sens comme une légende du football en comparaison:

Pour en savoir plus sur l’intelligence générale artificielle

La conférence de Ray Kurzweil:

Joshua Brett Tenenbaum, professeur de sciences cognitives et de calcul au MIT, explique comment nous pouvons atteindre la singularité de l’AGI:

J’espère que cela clarifie certains des points majeurs concernant l’AGI. Pour en savoir plus sur la façon dont l’IA change le monde, vous pouvez consulter les articles sur l’IA, les technologies de l’IA et les applications de l’IA dans le marketing, les ventes, le service client, l’informatique, les données ou l’analytique. Ou vous pouvez suivre notre page Linkedin où nous partageons la façon dont l’IA a un impact sur les entreprises et les particuliers ou notre compte twitter.

Et si vous avez un problème commercial qui n’est pas abordé ici :

Laissez-nous trouver le bon fournisseur pour votre entreprise.

0 commentaire